大家好!今天要和大家聊聊最近科技圈的大新闻——曾经被戏谑“沉睡”的谷歌,这次是真的醒过来了!它不仅让OpenAI如坐针毡,甚至还开始挑战英伟达的“铁饭碗”。这两个月以来,谷歌的势头可谓是挡也挡不住,动作频频,引人瞩目。

市值飙升,重回聚光灯下

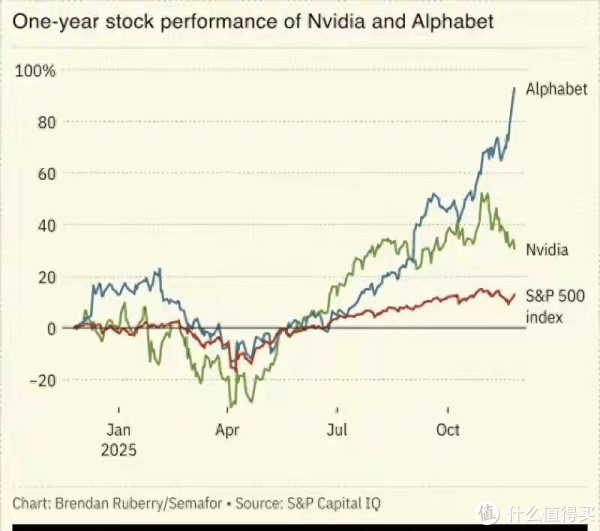

从11月下旬开始,谷歌的利好消息就接连不断。有传闻称Meta计划斥资数十亿美元采购谷歌自研的TPU芯片,消息一出,英伟达股价应声下跌近7%,而谷歌母公司Alphabet的市值则在一天之内飙升数百亿美元。

更惊人的是,仅仅从10月中旬到现在,谷歌的市值就累计上涨了近1万亿美元,一度逼近4万亿美元大关,创下历史新高。

这波暴涨并非空穴来风,其核心驱动力来自于谷歌最新发布的Gemini 3模型。它在LMArena等主流AI评测榜单上表现抢眼,稳居前列,尤其在推理和编程等硬核能力上,获得了行业的高度认可。

要知道,过去两年里,谷歌一度被外界贴上“掉队”的标签。尤其是2022年底ChatGPT横空出世之后,即便是作为Transformer技术奠基者的谷歌,也只能眼睁睁看着OpenAI率先实现技术商业化、引爆市场。当时谷歌匆忙推出的Bard,在ChatGPT面前,更像是一个仓促的追随者。

全栈式AI策略,谷歌的底气所在

那么,谷歌是如何实现这场“翻身仗”的呢?答案在于CEO皮查伊反复强调的“全栈式AI策略”。谷歌的AI布局并非只停留在模型层面,而是贯穿从上层应用、基础大模型,到云计算服务、自研芯片的每一个环节,形成了一个高度闭环的AI生态。

比如大家熟悉的NotebookLM笔记工具,以及火出圈的Nano Banana,都是谷歌基于自身AI技术打造的应用产品。相比之下,OpenAI虽然模型强大,但在基础设施上仍需依赖微软的云服务与英伟达的芯片支持。

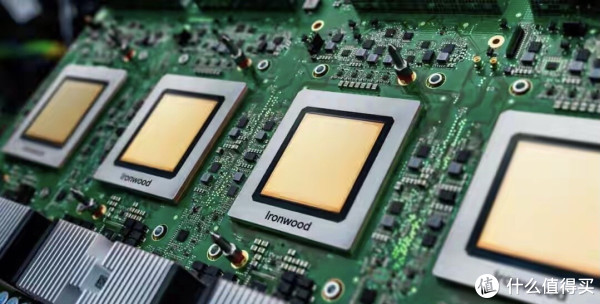

而谷歌真正的“王牌”,非TPU芯片莫属。从2015年开始,谷歌就自主研发并内部使用TPU,最初是为了提升搜索引擎的响应速度。经过十年迭代,如今已发展到第七代“Ironwood”,性能也从早期仅支持推理,扩展到能够承担大规模模型训练任务。目前,谷歌所有的Gemini模型都依托TPU完成训练,其技术实力不言而喻。

TPU走向台前,商业化进程加速

过去,TPU主要供谷歌内部使用,但随着Gemini模型的成功,谷歌开始积极将其推向市场。今年10月,AI公司Anthropic宣布将采购100万颗TPU,订单规模高达数百亿美元。值得注意的是,Anthropic在使用TPU训练Claude 3模型时,发现训练效率比传统GPU提升了20%,这也成为其选择谷歌的关键因素之一。

除Anthropic之外,包括Ilya Sutskever创办的Safe Superintelligence、Salesforce等知名企业也陆续成为TPU的客户。而最引人关注的,莫过于Meta的潜在订单——如果最终敲定,这将是TPU历史上最大规模的外部采购案。

此外,谷歌今年还推出了“TPU@Premises”计划,允许客户在自己的数据中心内部署TPU。高盛等对数据安全极为敏感的金融机构,已经率先试用了这一方案。

对谷歌云而言,TPU无疑是打破竞争僵局的重要武器。尽管第三季度谷歌云收入达到152亿美元,同比增长34%,但它仍落后于微软Azure和亚马逊AWS。若能通过TPU吸引更多大型客户,不仅将直接带动收入增长,也有助于提升谷歌云在行业内的整体地位。

有消息称,谷歌云内部甚至设定了抢占英伟达AI相关收入10%的目标。若以英伟达2025年预计490亿美元的AI收入计算,这意味着近50亿美元的市场规模,远超目前TPU的业务体量。

谷歌还具备一项难以复制的优势——数据。其搜索引擎、Android系统、YouTube等产品每天产生海量数据,为AI训练提供了源源不断的素材。更重要的是,这些数据谷歌可自主使用,无需像其他公司那样额外采购,成本优势显著。

挑战仍在,前路并不轻松

尽管谷歌势头强劲,但要说它已锁定胜局,还为时过早。首先在消费者市场中,Gemini与ChatGPT之间仍存在差距。谷歌宣称Gemini拥有6.5亿用户,但OpenAI的ChatGPT仅周活跃用户就高达8亿。根据Sensor Tower的数据,今年10月Gemini的下载量为7300万次,而ChatGPT达到9300万次,差距依然存在。

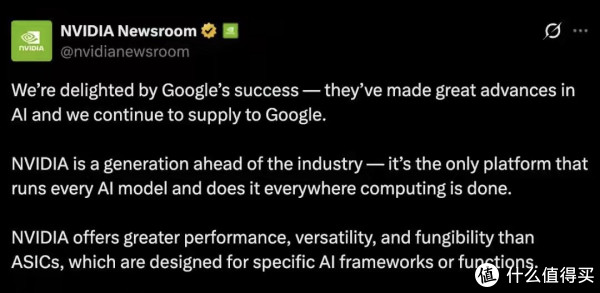

TPU的商业化之路也充满挑战。虽然推出了本地部署计划,但目前仍处于早期阶段,大多数开发者仍需通过谷歌云租用TPU。此外,一旦选择TPU,就意味着必须接入谷歌的软件生态,迁移成本极高。相比之下,英伟达的GPU具备更强的通用性,可以在任意云平台上灵活使用,开发者切换起来也更加自由。

即便是Meta这样的潜在客户,要实现从GPU到TPU的切换也绝非易事。Meta目前拥有庞大的GPU集群,而TPU的环形网络拓扑与GPU集群架构差异显著。即便Meta使用PyTorch框架能够在TPU上运行,仍需通过转换层,这不仅可能导致性能损失,也会增加开发复杂度。有消息称,Meta最早也要到2027年才有可能将TPU集成进其数据中心。

此外,英伟达也在积极巩固其护城河。在传出OpenAI有意采用水冷式TPU的消息后,英伟达迅速投入1000亿美元进行反击,最终换来了OpenAI继续使用其下一代GPU的承诺。而在Anthropic与谷歌合作后,英伟达又联合微软为其提供了价值300亿美元的Azure计算容量,以维系客户关系。

可以说,谷歌凭借全栈式AI布局与TPU的逐步开放,打出了一场漂亮的翻身仗。然而,要在AI芯片领域真正撼动英伟达的霸主地位,谷歌依然有很长的路要走。AI芯片之争,才刚刚进入白热化阶段,好戏还在后头。